Manual de Gobernanza de IA empresarial: Mitigando riesgos éticos

La gobernanza de IA es el conjunto de decisiones, roles y controles que permiten usar inteligencia artificial con trazabilidad y responsabilidad. En empresas medianas y grandes, esto reduce riesgos éticos de IA asociados a opacidad, sesgos, uso indebido de datos y falta de rendición de cuentas, sin frenar la adopción en áreas críticas.

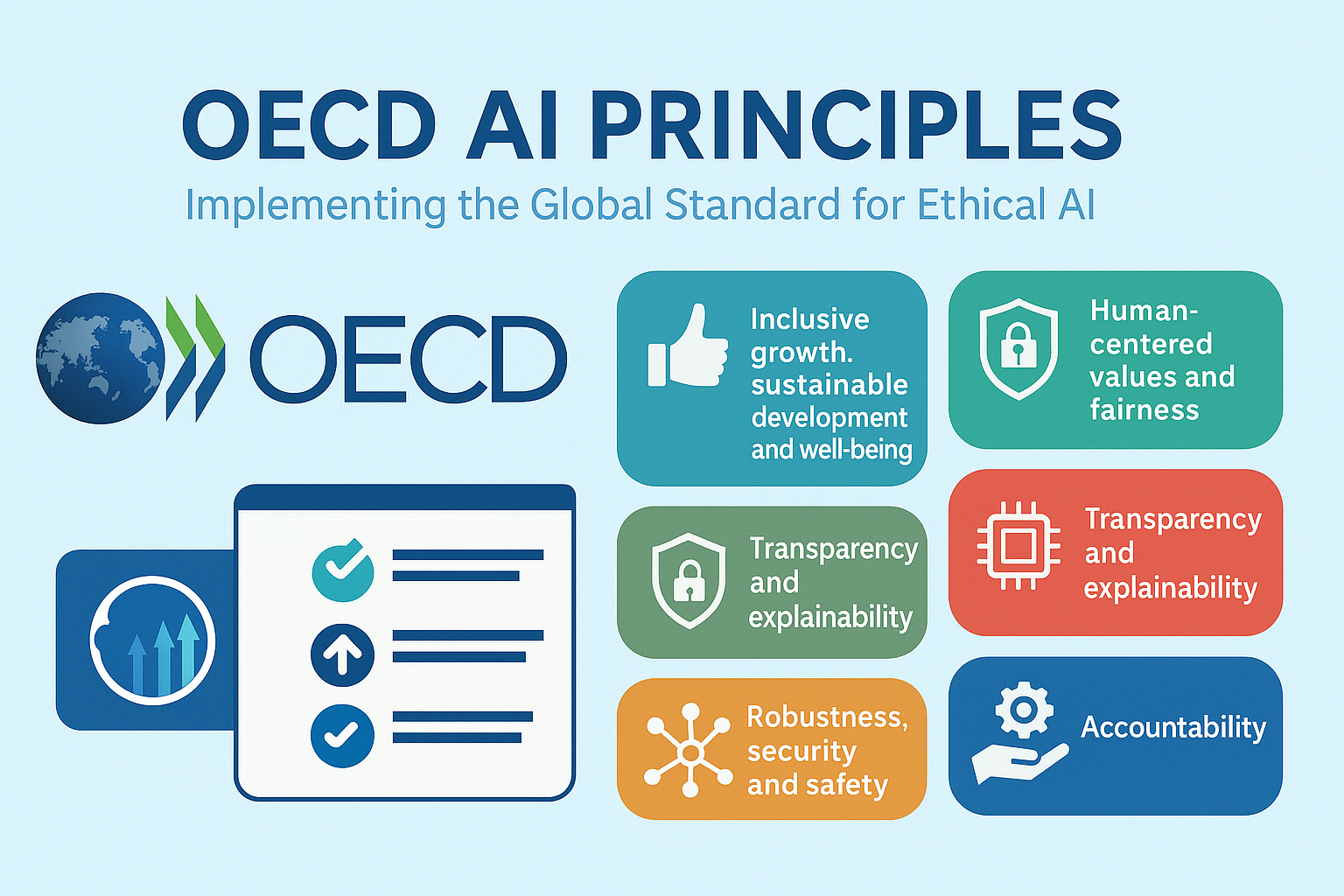

Gracias a la gobernanza de la IA, la conversación ya no es si se debe usar, sino cómo se controla. Los Principios de la IA creados por la Organización para la Cooperación y el Desarrollo Económico (OCDE) se adoptaron en 2019 y hoy cuentan con 47 jurisdicciones adherentes. Su actualización en el 2024 refuerza temas que pegan directo a la agenda ejecutiva; con temas en seguridad, privacidad, derechos de propiedad intelectual e integridad de la información.

En paralelo, el World Economic Forum lanzó la AI Governance Alliance en 2023 para impulsar recomendaciones de adopción responsable, con prioridad en sistemas seguros, aplicaciones sostenibles y gobernanza resiliente. En la práctica, esto importa porque los términos de uso y privacidad de plataformas y proveedores evolucionan rápido. En Crowe México te hemos englobado ambas, para que logres mitigar los riesgos éticos de IA al emplearla en la toma de decisiones.

Fuente: VerityAI

Transparencia algorítmica: Cómo evitar el "sesgo de caja negra" en sus modelos de negocio

¿Qué debe exigir la empresa cuando adopta IA para evitar decisiones inexplicables?

La Gobernanza de IA significa definir reglas de control cuando la IA influye en aprobaciones, priorizaciones o evaluaciones dentro del negocio. La transparencia no exige ser técnico; exige trazabilidad mínima para explicar resultados con claridad: qué datos entran, qué decide, qué límites tiene y quién responde. Esto reduce riesgos éticos de IA y fortalece el control interno.

¿Qué señales alertan a Finanzas, Operaciones y Compliance de un Black Box Risk?

- El proveedor no describe datos de entrada/salida y límites de uso

- No existe documentación de propósito ni casos prohibidos

- No hay claridad sobre errores conocidos o condiciones de falla

- El negocio no puede replicar un resultado con evidencia.

¿Qué paquete de evidencia es razonable pedir al proveedor sin entrar a ingeniería?

- Ficha de uso (propósito, alcance, exclusiones)

- Trazabilidad del flujo (inputs permitidos, outputs esperados)

- Reglas de supervisión humana (cuándo se valida, cuándo se bloquea)

- Bitácora de cambios (actualizaciones, versiones, incidentes)

Protección de datos y propiedad intelectual en la era de la IA generativa

¿Qué reglas internas debe definir la empresa antes de permitir IA generativa en equipos y procesos?

La IA generativa acelera tareas, pero también puede amplificar riesgos si se adopta sin controles. La gobernanza de IA debe establecer reglas claras antes de habilitar su uso; qué no se ingresa, qué herramientas están aprobadas, quién autoriza excepciones y cómo se verifica el cumplimiento. Esto ayuda a disminuir riesgos éticos de IA vinculados a exposición de información y usos no autorizados.

¿Qué información nunca debería entrar a IA generativa sin control explícito?

- Datos personales o sensibles

- Información financiera no pública

- Contratos, estrategias, pricing, condiciones comerciales

- Propiedad intelectual propia o de terceros (material creativo, código, materiales internos)

¿Cómo proteger la propiedad intelectual y evitar la contaminación de contenidos?

- Definir política de autoría y reutilización de outputs

- Requerir registro de prompts y salidas en procesos críticos

- Establecer revisión humana para contenidos con impacto legal, laboral o reputacional

- Alinear contratos con proveedores (confidencialidad, retención, uso de datos)

Estos puntos consolidan una gobernanza de IA que protege activos intangibles y reduce riesgos éticos de IA sin frenar la productividad.

El Comité de Ética Digital: Por qué tu empresa necesita uno hoy mismo

¿Qué problema resuelve un Comité de Ética Digital cuando la empresa adopta inteligencia artificial por todas partes?

Sin una instancia de decisión, la IA se expande por áreas aisladas con criterios distintos y brechas de control. Un comité formaliza la gobernanza de IA; prioriza casos de uso, aprueba reglas comunes y detiene iniciativas cuando el riesgo supera el beneficio. Es una medida práctica para contener riesgos éticos de IA y mantener consistencia en toda la organización.

¿Quién debe sentarse en el comité si el objetivo es control y continuidad del negocio?

- Dirección / patrocinio ejecutivo (CEO o comité directivo)

- Finanzas (CFO) por impacto en riesgo y control interno.

- Compliance / Riesgos (marco, evidencias, incidentes)

- Operaciones (procesos críticos)

- RH (uso en talento, evaluaciones, clima y equidad)

- TI/Datos como habilitadores (sin convertirlo en comité técnico)

¿Qué decisiones debes tomar y documentar para que no sea un comité decorativo?

- Catálogo de casos de uso y nivel de riesgo

- Lista de herramientas aprobadas y criterios de adquisición

- Política de datos y de uso de IA generativa

- Protocolo de incidentes (qué se hace, quién decide, cómo se corrige)

- Indicadores de control (cumplimiento, excepciones, hallazgos)

Auditoría de IA: Validando la precisión y legalidad de los sistemas automatizados

¿Qué se audita cuando la IA es un sistema comprado o integrado, no construido internamente?

Se audita el uso, no el algoritmo: si el sistema está dentro del propósito autorizado, si respeta reglas de datos, si mantiene evidencia de decisiones, si tiene supervisión humana donde corresponde y si su desempeño no degrada procesos críticos. La gobernanza de IA define qué se revisa, con qué frecuencia y con qué evidencia, para que la IA sea un activo controlable.

¿Qué controles son clave para Compliance cuando la IA toca procesos sensibles?

- Evidencia de decisiones (logs, criterios, revisiones)

- Gestión de cambios (actualizaciones, versiones, retrain cuando aplique)

- Pruebas de desempeño operativo (precisión funcional vs objetivos del proceso)

- Gestión de incidentes (detección, contención, remediación)

- Segregación de funciones (quién configura vs quién aprueba)

¿Qué entregables debe generar la auditoría para servir en comités, riesgos y control interno?

- Inventario de sistemas automatizados y casos de uso

- Matriz de riesgos y controles por sistema

- Hallazgos priorizados (impacto, probabilidad, plan de acción)

- Evidencia de cumplimiento de políticas internas (datos, accesos, revisiones)

Comienza a aplicar la gobernanza de IA para mitigar riesgos éticos y proteger el valor de tu negocio

La gobernanza de IA convierte la adopción de inteligencia artificial en una práctica controlable y alineada a tu negocio. Cuando las organizaciones definen reglas de transparencia, uso responsable de datos, resguardo de propiedad intelectual, rendición de cuentas y auditoría, la IA deja de ser una “caja negra” y se vuelve en una herramienta confiable. Este enfoque te ayudará a contener los riesgos éticos de IA sin frenar la velocidad operativa, porque establece límites claros y evidencia para que puedas decidir con seguridad.

Si tu empresa ya está usando IA, o planea escalarla, Crowe México puede orientarte para explorar el nivel de madurez actual de la implementación, identificar brechas de control y definir un camino de gobernanza que sea realista para tu estructura y tus prioridades. El objetivo es avanzar con claridad, reducir riesgos éticos de IA y fortalecer la toma de decisiones en áreas críticas. Contáctanos y comienza a trabajar de la mano de nuestros expertos.